Linear Algebra 1 - Continuous Random Variable

Before starting

“Class” 카테고리에 있는 포스팅들은 실제로 수업에서 배운 내용을 정리하려는 목적으로 작성되었다. 이 글은 그 중 Linear Algebra 과목의 수업을 다룬다…만, 과목명은 페이크고 사실은 생성형 모델을 다루는 수업이다. 그래서 이론적인 기초 내용도 선형대수 쪽이 아니라 확률론을 다뤘다(…)

Continuous Random Variable

AI에 관한 모든 것은 random variable이라는 개념에서 출발한다.

확률적인 사건은 사실 그냥 수학적으로 다루기 쉽지 않다. “동전이 앞면이 나올 확률”, “키가 170이상일 확률” 등과 같이 수학적인 언어로 기술되어 있지 않는 경우가 많기 때문이다. 이러한 사건들을 수학적으로 기술하기 위해, random variable이라는 개념이 등장한다. $X$는 variable이라는 이름과는 다르게 $X: \Omega \rightarrow \mathbb{R}$로 정의된다. 여기서 $\Omega$는 시행에서 발생할 수 있는 모든 결과들의 집합을 의미하며, 이를 수치적으로 계산할 수 있게 실수로 바꿔주는 역할을 한다. {앞, 뒤, 앞, 뒤}라는 비수치적인 결과들에 $X$를 통과시켜야 ${1, 0, 1, 0}$이라는 수치적인 값이 나오고, 비로소 다양한 수학적 도구를 사용할 수 있게 된다.

그래서 사실 $X=1$로 쓰기보다는 $X(\omega)=1$로 쓰는게 옳은 표현이지만, 위의 고찰은 이후 논의에서 크게 중요한 부분이 아니라 대세를 따라 $X=1$과 같은 식으로 표기하겠다.

Random variable을 통해 각각의 사건들을 실수로 변환시킬 방법을 찾았다. 그 후 해야할 일은 특정 사건이 발생할 확률을 구하는 일이고, 더 나아가 이 확률이 어떤 식으로 구성되어 있는지를 파악하는 것이다. 수학의 세계로 확률을 끌어들였으니 이를 함수로 기술할 수 있을 것이다.

보다 구체적으로, random variable $X$가 특정 값 범위를 가질 확률을 $f_X(x)$의 형태로 기술할 수 있을 것이다. 여기서 그 특정 값 범위가 연속적이냐 이산적이냐에 따라 $f_X(x)$가 확률밀도함수(Probability Density Function, PDF)인지 확률질량함수(Probability Mass Function, PMF)인지가 결정된다. 다만 이 수업에서는 연속적인 random variable에 대해서만 생각하기로 하자.

이렇게 PDF를 기술하면, $X$가 특정한 범위를 가질 확률을 다음과 같이 구할 수 있다.

\[P(X \in B) = \int_{B} f_X(x)dx\] \[P(a \leq X \leq b) = \int_{a}^{b} f_X(x)dx\]즉, PDF로 표현뒨 부분의 넓이가 곧 확률이 된다. 그러면 적분으로 표현되는 특성상 특정 점에서의 확률이란건 0이 될 수 밖에 없다.

\[P(X = a) = \int_{a}^{a} f_X(x)dx = 0\]여기서 다음과 같은 특징을 얻을 수 있다. 즉, 경계값은 확률을 구하는 데에 아무 영향을 끼치지 못한다.

\[P(a \leq X \leq b) = P(a \lt X \lt b) = P(a \leq X \lt b) = P(a \lt X \leq b)\]그리고 PDF는 “확률”을 기술하고자 하는 함수고, 그 확률은 적분을 통해 구할 수 있기 때문에 모든 사건을 합한 전체 확률은 당연히 1이 된다.

\[P(-\infty \lt X \lt \infty) = \int_{-\infty}^{\infty} f_X(x)dx = 1\]Expectation

그럼 이제 이 random variable과 분포를 가지고 해볼 수 있는 연산이 뭐가 있을까? 가장 먼저 떠오르는 것은 기댓값, 혹은 평균이다. 각각의 값과 그에 해당하는 사건이 발생할 확률을 곱하면 기댓값을 구할 수 있듯이, PDF가 주어졌을 때 기댓값은 다음과 같이 구할 수 있다.

\[E[X] = \int_{-\infty}^{\infty} xf_X(x)dx\]그리고 역시 적분으로 계산되는 특성상 확률변수에 다른 연산을 취해도 위의 형태가 그대로 보존된다.

\[E[g(X)] = \int_{-\infty}^{\infty} g(x)f_X(x)dx\]기댓값은 선형성을 가진다. 즉, 다른 확률변수 $Y = aX+b$가 있다면, $E[Y]$는 다음과 같다.

\[E[Y] = E[aX + b] = aE[X] + b\]직관적으로 생각해봐도, 확률분포를 통째로 선형적으로 이동하면 그 기댓값 역시 동일하게 이동할 것이다.

Variance

Random variable과 분포를 가지고 계산해볼 수 있는 또 다른 값은 분산(Variance)이다. 분산은 말 그대로 이 확률분포가 얼마나 퍼져있는지를 알려주는 값으로, 기댓값과 얼마나 떨어져있는지를 기준으로 한다. 구체적으로는, 다음과 같이 구할 수 있다.

\[var(X) = E[(X-E[X])^2] = \int_{-\infty}^{\infty} (x - E[X])^2 f_X(x)dx\]즉, 기댓값과의 차이를 제곱한 값의 평균을 구하는 것이다. 제곱이 끼어있기 때문에 분산은 항상 0 이상이 된다.

분산은 선형성을 가지지 않는다. 다른 확률변수 $Y = aX+b$에 대해, $var(Y)$는 다음과 같다.

\[var(Y) = a^2 var(X)\]역시 직관적으로 생각해보면, 분산은 기댓값과 얼마나 떨어져있는지를 나타내주는 지표이기 때문에, 단순한 수직이동에 불과한 상수항 $b$는 분산에 영향을 끼치지 않고, 계산상 기댓값과의 차이를 제곱해서 구하기 때문에 $a^2$배가 된다고 생각할 수 있다.

Cumulative Distribution Function

Cumulative Distribution Function, 즉 CDF는 특정 값 $x$까지의 누적 확률을 구하는 함수이다.

\[F_X(x) = P(X \leq x) = \int_{-\infty}{x} f_X(t)dt\]누적확률이기 때문에, 당연히 단조증가함수이다.

그리고 PDF와 CDF는 서로 미분과 적분 관계에 있다. 즉, PDF를 적분하면 CDF고 반대로 CDF를 미분하면 PDF가 된다.

\[F_X(x) = \int_{-\infty}{x} f_X(t)dt, f_X(x) = \dfrac{dF_X}{dx}(x)\]Univariate Gaussian Random Variable

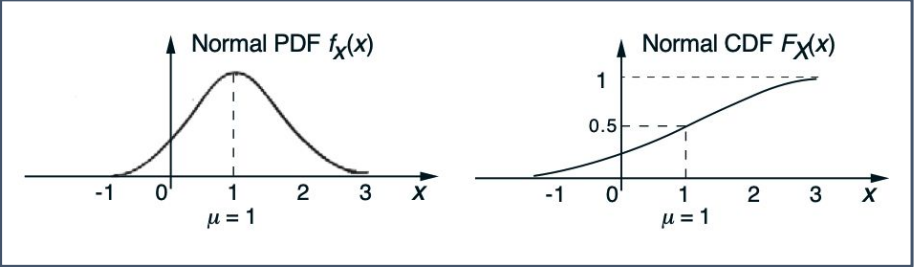

가우시안분포, 혹은 정규분포는 다음과 같은 형태의 PDF를 가진 분포를 뜻한다.

\[f_X(x) = \dfrac{1}{\sqrt{2\pi}\sigma}e^{-(x-\mu)^2/2\sigma^2}\]수식은 상당히 복잡한데, 이걸 그래프로 그리면 우리가 흔히 아는 그 종모양의 그래프가 된다.

위의 정의들에 의해 기댓값과 분산을 계산해보면 $E[X] = \mu$, $var(X) = \sigma^2$이 나온다.